![]() Professur für Photogrammetrie und Fernerkundung

Professur für Photogrammetrie und Fernerkundung

Department of Aerospace and Geodesy

TUM School of Engineering and Design

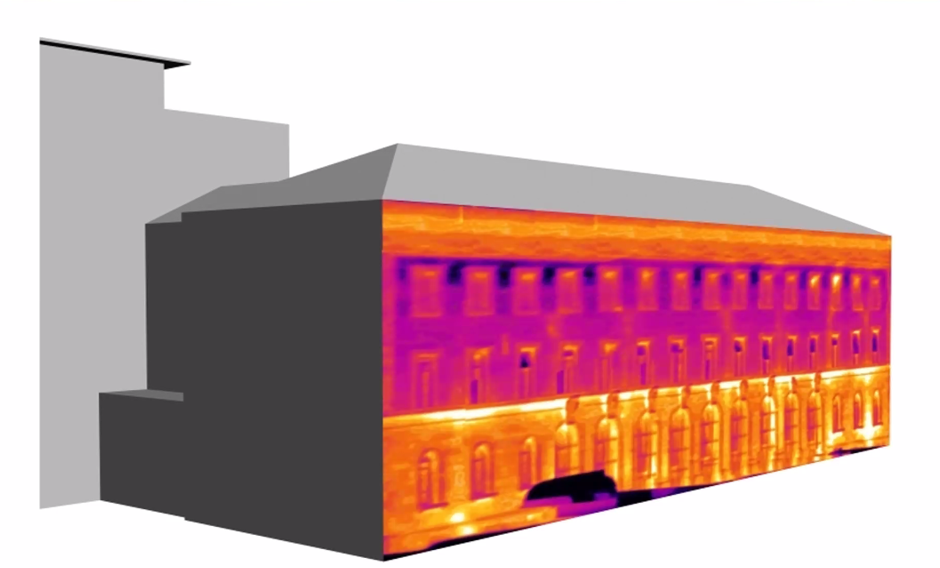

The aim of the proposed project is to thermally record both the external and internal building surfaces and to spatially locate the measurements with the aid of a building model. Due to the fact that temperature is volume related, this strategy follows the idea “from surface to volume”. For this purpose, radiometric and geometric information will be recorded simultaneously at different times with a multi-sensor system consisting of a TIR camera and a laser scanner. Special challenges arise not only from the calibration, but also from the different conditions in the indoor and outdoor space regarding the resolution (multi-scale), the position and orientation determination, the co-registration and the corresponding analysis of spatial thermal structures. The relation between indoor and outdoor model shall be established by an automatic detection of windows and doors. Noticeable thermal structures which are difficult to describe by parametric models should be labeled and analyzed using a convolutional neural network (CNN).

This is a subproject of the AI4TWINNING project funded by TUM Georg Nemetschek Institute Artificial Intelligence for the Built World

Read more: AI4TWINNING - Thermal 3D mapping and CNN analysis

Das beantragte Projekt hat zum Ziel, Methoden und Techniken für eine robuste automatisierte Überwachung des Fortschritts von Bauvorhaben (Hochbau) zu entwickeln. Diese beruhen auf dem Abgleich von Punktwolken, die aus photogrammetrischen Aufnahmen oder Laserscans der Baustelle erzeugt werden, mit einem 4D-Bauwerksmodell, das die dreidimensionale Geometrie von Bauteilen mit einer graphbasierten Repräsentation der zugehörigen Bauprozesse kombiniert.

Das Projekt wird am Leonhard Obermeyer Center zusammen mit dem Lehrstuhl für Computergestützte Modellierung und Simulation bearbeitet.

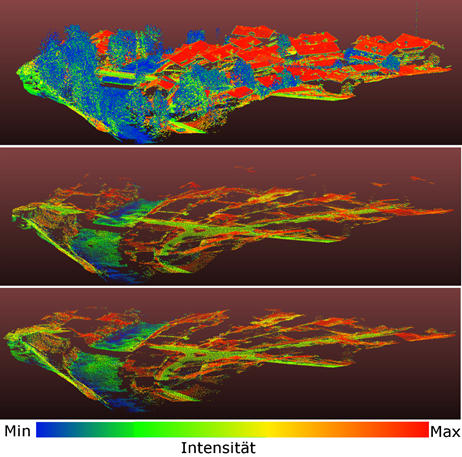

In diesem Teilprojekt der Verbundprojektes For3D der Bayerischen Forschungsstiftung sollen neue Verfahren zur Änderungsanalyse in Punktwolken entwickelt werden. Dabei sollen einerseits Punktwolken von verschieden Sensoren oder Auswerteverfahren fusioniert und zudem mit Aufnahmen zu unterschiedlichen Zeitpunkten verglichen werden. Dazu ist zunächst ein automatisches und hochgenaues Zuordnungsverfahren zu entwickeln. Unter Berücksichtigung der sensortypischen und oberflächen- bzw. materialabgängigen Aufnahmegenauigkeiten sind Änderungen zu detektieren, die auf eine Änderung der 3D-Szene und nicht auf Ungenauigkeiten bei der Generierung der Punktwolke zurückzuführen sind. Als Anwendungsgebiet sollen hauptsächlich Fragestellungen in Zusammenhang mit der Erfassung von Flussläufen durch Lasertopobathymetrie bearbeitet werden. Topobathymetrische Laserscanningdatensätze bilden sowohl Objekte oberhalb der Wasseroberfläche (Topographie) als auch unterhalb der Wasseroberfläche bzw. in der Wassersäule ab (Bathymetrie). Das Fehlen von festen und geometrisch eindeutigen Strukturen (z.B. Gebäude, Straßen) in dieser Messumgebung (Gewässerräume) erschwert nicht nur den Streifenabgleich innerhalb eines Datensatzes sondern vor allem die Referenzierung verschiedener zeitlicher Perioden der gleichen Messumgebung.

In diesem Teilprojekt der Verbundprojektes For3D der Bayerischen Forschungsstiftung sollen neue Verfahren zur Änderungsanalyse in Punktwolken entwickelt werden. Dabei sollen einerseits Punktwolken von verschieden Sensoren oder Auswerteverfahren fusioniert und zudem mit Aufnahmen zu unterschiedlichen Zeitpunkten verglichen werden. Dazu ist zunächst ein automatisches und hochgenaues Zuordnungsverfahren zu entwickeln. Unter Berücksichtigung der sensortypischen und oberflächen- bzw. materialabgängigen Aufnahmegenauigkeiten sind Änderungen zu detektieren, die auf eine Änderung der 3D-Szene und nicht auf Ungenauigkeiten bei der Generierung der Punktwolke zurückzuführen sind. Als Anwendungsgebiet sollen hauptsächlich Fragestellungen in Zusammenhang mit der Erfassung von Flussläufen durch Lasertopobathymetrie bearbeitet werden. Topobathymetrische Laserscanningdatensätze bilden sowohl Objekte oberhalb der Wasseroberfläche (Topographie) als auch unterhalb der Wasseroberfläche bzw. in der Wassersäule ab (Bathymetrie). Das Fehlen von festen und geometrisch eindeutigen Strukturen (z.B. Gebäude, Straßen) in dieser Messumgebung (Gewässerräume) erschwert nicht nur den Streifenabgleich innerhalb eines Datensatzes sondern vor allem die Referenzierung verschiedener zeitlicher Perioden der gleichen Messumgebung.

Read more: For3D - Änderungsdetektion topobathymetrischen Punktwolken

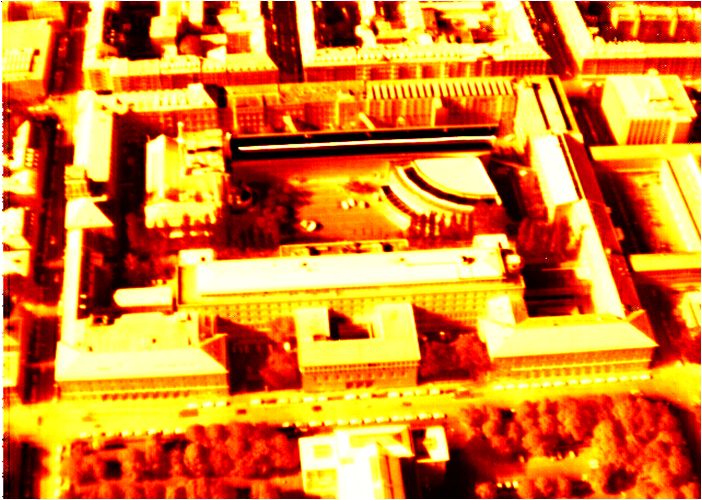

The project serves two principal goals: (i) to extract and interpret non-visible features of buildings from thermal infrared (TIR) data based on image analysis and (ii) to update and enrich the 3D building models with the information derived from non-visible features.

The project serves two principal goals: (i) to extract and interpret non-visible features of buildings from thermal infrared (TIR) data based on image analysis and (ii) to update and enrich the 3D building models with the information derived from non-visible features.

Several investigation has been done within the project which required the development of methods for geometric calibration of infrared cameras, methods for relative orientation using correlation and feature points, and methods for matching of images and image sequences with existing building models considering thermal infrared imagery.

Read more: Thermal Building Textures from Infrared Image Sequences

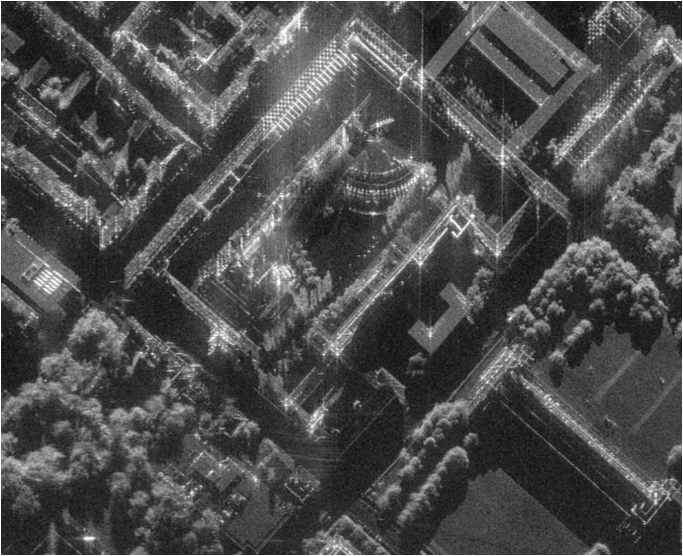

Ziel dieses Vorhabens ist es, Verfahren zu entwickeln, die aus mehreren Ansichten einerseits

Ziel dieses Vorhabens ist es, Verfahren zu entwickeln, die aus mehreren Ansichten einerseits

stabilere Analyseergebnisse liefern und andererseits die durch die Aufnahmegeometrie gegebenen

Schwächen beseitigen. Zusätzlich sind Algorithmen zu entwickeln, die aus den Ansichten 3DInformationen

ableiten und diese mit Ergebnissen aus interferometrischen 3D-Bestimmungen

vergleichen.